Présentation

Le colloque historique Presaje / Cour d’appel de Paris : « Intelligence artificielle et droit » ouvert aux magistrats et leurs précieux collaborateurs, juristes assistants, assistants spécialisés, assistants de justice, fonctionnaires des services du greffe, avocats, chercheurs et doctorants en droit se déplace en 2026 à l’EDHEC (Ecole des Hautes études commerciales du Nord) qui dispose d’un pôle de recherche « Droit & IA, numérique ».

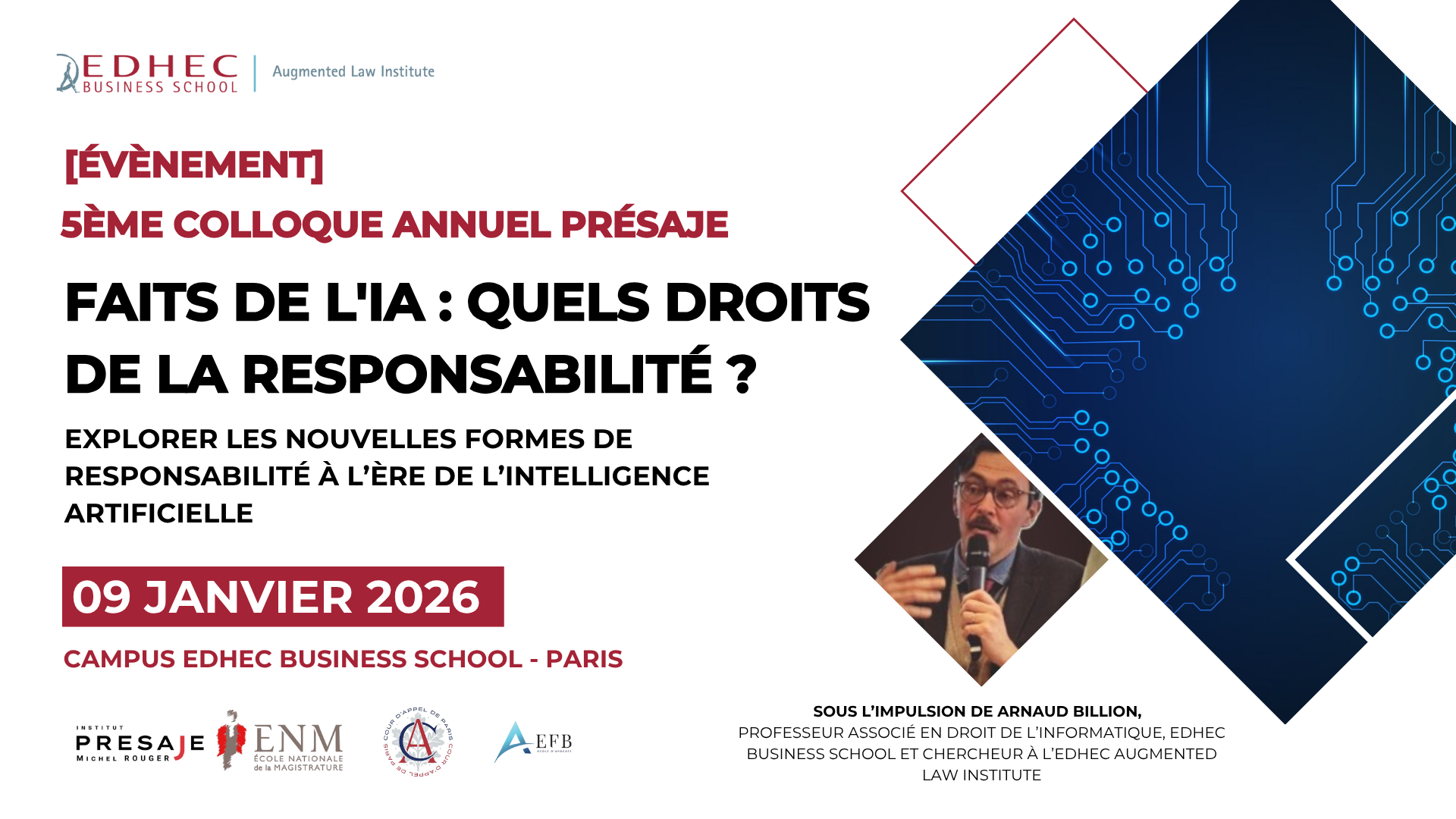

Fait(s) de l’IA: Quels droits de la responsabilité ?

L’IA (dispositifs informationnels en réseau) produit des effets indéniables aux plans social et technique, faits que le juriste voudra qualifier notamment au regard du droit de la responsabilité. Continuité d’internet en version dite « intelligente », les propositions d’IA (américaines, chinoises…) ont entraîné l’Europe à multiplier – trop vite ? – les instruments de régulation (RGPD, DSA, DMA, RIA…). Sans cadre unifié aujourd’hui pour traiter les questions de responsabilité juridique liées à l’IA.

Le retrait récent du projet de Directive sur l’adaptation du droit civil à l’IA semble ouvrir une opportunité : celle de repenser les modèles juridiques disponibles pour comprendre et encadrer l’IA dès lors que ces dispositifs nuisent aux droits de l’homme, socle juridique européen (droit à une procédure, droit d’expression…).

Ce colloque interdisciplinaire interroge les modèles existants de responsabilité – individuelle, collective, systémique – et les articulations entre responsabilité juridique et responsabilité sociétale. En croisant les regards d’universitaires, de magistrats, d’avocats, de responsables conformité et d’éthiciens, il s’agira de comprendre comment le droit peut (re)prendre prise sur les chaînes de décision automatisées et sur les effets concrets de l’IA dans nos sociétés.

Direction scientifique:

Pascale de Rozario, Christian Rolando, Pierre-François Euphrasie

Conseil scientifique:

Arnaud Billion

Programme du 9 janvier 2026

9h30 - Accueil

10h - Ouverture du colloque : De l’IA & du Droit

- Christophe Roquilly, Directeur de l’EDHEC Augmented Law Institute

10h15 - Autres regards civilisationnels sur la responsabilité

- Dr. Anaëlle Martin, Université de Strasbourg

Le droit de la responsabilité tel que nous l'envisageons est assis sur un système culturel, philosophique et méthodologique très circonstancié. Il n'est pas inutile, à l'heure d'une globalisation manifestée par l'"ordinaterre" (J. Rohmer) de nous partir en quête des ressources d'autres cultures, d'autres philosophies, tout simplement d'autres pensées, à la recherche du "libre arbitre", point de fuite et universel questionnement renouvelé par la perspective d'une IA totale, d'un ordinateur-univers ayant ôté tout sens à la notion de responsabilité.

10h45 - Table ronde des doctorants en droit & IA: Les modèles de responsabilité de l’IA en Europe : une controverse

Les systèmes d’intelligence artificielle, en effaçant la distinction entre l’action humaine et l’action automatisée, soumettent les fondements classiques de la responsabilité juridique à une épreuve inédite. Cette table ronde prend la forme d’une disputatio, au cours de laquelle chaque doctorante défend un modèle conceptuel de responsabilité appliqué à l’IA – qu’il s’agisse de la faute, du risque, de la causalité ou de la responsabilité absolue. La controverse explore la cohérence de ces paradigmes face à la délégation de décision technique et questionne la nécessité d’un régime sui generis propre à la responsabilité algorithmique.

- Coordinateur : Dr Christian Rolando, Docteur en droit, médiateur près la Cour d’appel de Montpellier, enseignant à l’Université de Perpignan et à l’ICES,

- Le modèle de la responsabilité absolue: Selma Demir, Doctorante en droit privé, Institut François Geny, Université de Lorraine,

- Le modèle « Risque/négligence » : Ummihan Ozturk, doctorante en droit public, Centre Michel de l'Hospital à Clermont-Ferrand,

- Intervention conclusive : Dr. Pierre-François Euphrasie, Droit de l’intelligence artificielle, juriste d’entreprise

Au fondement de la responsabilité, comme de toute règle juridique, se trouve une philosophie servant de base à la construction des régimes. Ces fondements constituent des repères dont on s’éloigne ou se rapproche, au gré des conditions ensuite édictées dans les textes pour engager un régime de responsabilité. Les fondements traditionnels de la responsabilité demeurent alors de bons repères pour réparer le dommage généré par l’intelligence artificielle, même s’ils présentent certaines faiblesses classiques. Envisager un nouveau modèle de responsabilité pour pallier ces faiblesses apparaît alors comme une solution possible, sans être pour autant indispensable.

12h15 - Premier Dialogue - Droits de l’homme, citoyenneté & IA

- Dr Pascale de Rozario, sociologue, Maître de conférences (hdr), chercheur au lab. Lirsa (EA4603, recherche sur les sciences de l’action, Cnam),

- Diane Galbois-Lehalle, Maître de conférences, titulaire de la Chaire numérique et citoyenneté, directrice du Master droit de l'intelligence artificielle (Institut catholique de Paris), EA 7403 « Religion, Culture & Société »

La « modernité » désigne des projets de dépassements individuels et collectifs où l’actuel est insatisfaisant, voire toxique. Cette vision du monde se reconnaît par des « marqueurs » dont l’impératif d’innovation technologique et scientifique, avec peu de considérations humanistes. L’IA - algorithmes de recommandation, IA générative, IA agentique - entraîne-t-elle un risque de déresponsabilisation de l'humain ? Les textes européens permettent-ils d'identifier clairement le responsable des possibles dommages causés par les systèmes d'IA ? La confiance en cette technologie en dépend, pour enrichir notre compréhension de l’humain et de la place de la machine la société.

13h-14h30 - Pause déjeuner

14h30- Deuxième Dialogue - IA & Dynamique managériale : quelles responsabilités ?

- Dr Arnaud Billion, Professeur de droit à l’EDHEC Augmented Law Institute,

- Dr Sabrina Hammoudi, Maîtresse de conférences, Université Catholique de Lyon

Au-delà de la fiction, "IA" désigne à la fois des logiciels reconfigurables selon un aléa contrôlé et la transformation de l'information produite par ces logiciels, qu'il s'agisse de renseignements interprétables ou de données de gestion des entreprises. IA est donc devenue un rouage de "l'entreprise-tableur" (P.-Y. Gomez), rouage qui impacte profondément le coeur-même du réacteur des processus métiers et décisions des entreprises et administrations. Le narratif de l'agent d'IA rappelle à cet égard celui de l'agent administratif, entité agissante et irresponsable, pure effectuation de la règle qui l'environne. Il vaut alors de discuter l'impact institutionnel systémique d'IA ainsi que d'évaluer sa valeur juridique et démocratique.

15h15 - Troisième Dialogue - Droits de la responsabilité de l’IA : où en est-on ?

- Thomas Cassuto, Magistrat, Président de chambre à la cour d’appel de Reims, Président de l’Institut Présaje – Michel Rouger,

- Omar Ennaji, Legal & Policy Officer, Commission européenne, Direction générale Marché intérieur, Industrie, Entreprenariat et PME.

Le 28 septembre 2022, la Commission européenne a présenté une proposition de directive relative à l’adaptation des règles en matière de responsabilité civile extracontractuelle au domaine de l’intelligence artificielle (Directive sur la responsabilité en matière d’IA - COM(2022) 496 final). Cette proposition, présentée avant la diffusion au grand public des IAGen, avait pour objectifs d’assurer une protection uniforme aux personnes lésées par des systèmes d’intelligence artificielle, de garantir une protection équivalente à celle offerte en cas de dommages causés par une autre technologie et faciliter l’accès à la réparation pour les victimes en instaurant une présomption de lien de causalité entre la faute du « fournisseur » ou du « déployeur » d’un système d’IA et les dommages subis. Ce texte pose plus généralement la question de l’harmonisation des règles de responsabilité extra-contractuelle à l’échelle de l’Union. En février 2025, il est devenu évident que la Commission suspendait la défense de ce projet. Après ce retrait de facto du projet de directive sur la responsabilité en matière d’IA, en raison d’un «défaut d’accord prévisible» et en l’absence de perspective de nouvelle proposition ou d’une approche alternative à l’avenir ; quelle stratégie européenne la Commission peut-elle adopter en matière de responsabilité du fait de l’IA, au vu des contraintes et des enjeux en matière de géopolitique du numérique, du caractère systémique croissant de l’IA et des limites inhérentes de la compétence communautaire ainsi que l’efficacité du caractère prescriptif des normes?

16h15 - Quatrième Dialogue - L’IA comme outil pour les avocats : retours d’expériences sur Jurimétrie

- Maître Nathalie Navon-Soussan, Avocat au Barreau de Paris

- Maître Arnaud Lizop, Avocat au Barreau de Paris

Prolongement contemporain d’une fonction souveraine – établir et qualifier les faits par rapprochements – l’IA impose des contraintes méthodologiques inédites aux avocats, mais n’est pas leur substitut. Elle interroge, inquiète, repousse. Interroger ces résistances légitimes peut seul répondre au besoin de Droit, qui n’a jamais été aussi vaste aujourd’hui. Du point de vue de la profession et sa déontologie, l’intelligence de l’aléa judiciaire ne pourra pas s’automatiser. L’IA invite à un exercice professionnel plus exigeant.

17h15 - Quid de la compliance en entreprise ?

- Imane Idrissi, juriste & DPO IA

Les entreprises doivent faire face à une multiplicité de contraintes juridiques, de compliance et parfois de régulation, contraintes qui peuvent apparaître tant comme des freins que comme des tenseurs stratégiques. Nous envisagerons les organisations et gouvernance d’entreprise capables de répondre à ces défis.

18h fin

Inscription obligatoire